Ai2, Yeni Eğitim Sonrası Yaklaşımla Tülu 3'ü Yayınladı

Bugün, Allen Yapay Zeka Enstitüsü ( Ai2 ), açık kaynaklı Tülu 3 405 milyar parametreli büyük dil modelinin ( LLM ) lansmanı ile yarıştaki en son girişini başlattı. Yeni model yalnızca OpenAI'nin GPT-4o'sunun yetenekleriyle eşleşmekle kalmıyor, aynı zamanda kritik kıyaslamalarda DeepSeek'in v3 modelini de geride bırakıyor.

Bu, Ai2'nin yeni bir model hakkında cesur iddialarda bulunduğu ilk sefer değil. Kasım 2024'te şirket, hem 8 hem de 70 milyar parametreli versiyona sahip olan Tülu 3'ün ilk sürümünü piyasaya sürdü. O sırada Ai2, modelin OpenAI, Anthropic'ten Claude ve Google'dan Gemini'nin en son GPT-4 modeliyle aynı seviyede olduğunu iddia etti. En büyük fark, Tülu 3'ün açık kaynaklı olmasıdır. Ai2 ayrıca Eylül 2024'te Molmo modellerinin bazı kriterlerde GPT-4o ve Claude'u yenebildiğini iddia etti.

Kıyaslama performans verileri ilginç olsa da, belki de daha yararlı olan, yeni Ai2 modelini mümkün kılan eğitim yenilikleridir.

Antrenman sonrası sınırları zorlamak

Tülu 3 405B için büyük atılım, ilk olarak 2024'te piyasaya sürülen ilk Tülu 3 ile ortaya çıkan bir yeniliğe dayanıyor. Bu sürüm, daha iyi performans elde etmek için gelişmiş eğitim sonrası tekniklerin bir kombinasyonunu kullandı.

Tülu 3 405B modeli ile, denetimli ince ayar, tercihli öğrenme ve daha büyük ölçeklerde istisnai olduğu kanıtlanmış yeni bir pekiştirmeli öğrenme yaklaşımını birleştiren gelişmiş bir eğitim sonrası metodoloji kullanılarak bu eğitim sonrası teknikler daha da ileri götürülmüştür.

Ai2 NLP Research kıdemli direktörü Hannaneh Hajishirzi, VentureBeat'e verdiği demeçte, "Tülu 3'ün eğitim sonrası tariflerini, bugüne kadarki en büyük ölçekli, tamamen açık kaynaklı eğitim sonrası modelimiz olan Tülu 3-405B'ye uygulamak, açık ince ayar tarifleri, veri ve kod sağlayarak oyun alanını düzleştiriyor, geliştiricileri ve araştırmacıları üst düzey kapalı modellerle karşılaştırılabilir performans elde etmeleri için güçlendiriyor" dedi.

RLVR ile eğitim sonrası açık kaynaklı yapay zekanın durumunu geliştirme

Eğitim sonrası, DeepSeek v3 de dahil olmak üzere diğer modellerin de yaptığı bir şeydir.

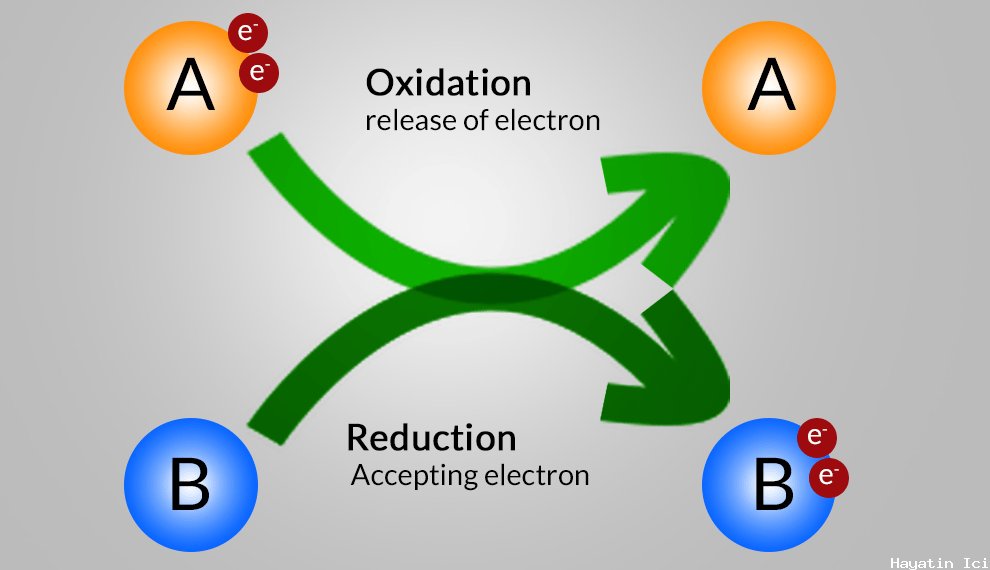

Tülu 3'ü farklılaştırmaya yardımcı olan en önemli yenilik, Ai2'nin "doğrulanabilir ödüllerden pekiştirmeli öğrenme" (RLVR) sistemidir.

Geleneksel eğitim yaklaşımlarından farklı olarak RLVR, modelin performansına ince ayar yapmak için matematik problemlerini doğru bir şekilde çözmek gibi doğrulanabilir sonuçlar kullanır. Bu teknik, doğrudan tercih optimizasyonu ( DPO ) ve dikkatle seçilmiş eğitim verileriyle birleştirildiğinde, modelin güçlü güvenlik özelliklerini korurken karmaşık akıl yürütme görevlerinde daha iyi doğruluk elde etmesini sağlamıştır.

RLVR uygulamasındaki önemli teknik yenilikler şunları içerir:

- 256 GPU'da verimli paralel işleme

- Optimize edilmiş ağırlık senkronizasyonu

- 32 düğüm arasında dengeli işlem dağılımı

- 16 tensör paralelliği ile entegre vLLM dağıtımı

RLVR sistemi, daha küçük modellere kıyasla 405B parametre ölçeğinde daha iyi sonuçlar gösterdi. Sistem ayrıca güvenlik değerlendirmelerinde özellikle güçlü sonuçlar gösterdi ve DeepSeek V3, Llama 3.1 ve Nous Hermes 3'ten daha iyi performans gösterdi. Özellikle, RLVR çerçevesinin etkinliği model boyutuyla birlikte arttı ve bu da daha büyük ölçekli uygulamalardan potansiyel faydalar sağladığını düşündürdü.

Tülu 3 405B, GPT-4o ve DeepSeek v3 ile nasıl karşılaştırılır?

Modelin rekabetçi konumu, mevcut AI ortamında özellikle dikkat çekicidir.

Tülu 3 405B, yalnızca GPT-4o'nun yetenekleriyle eşleşmekle kalmaz, aynı zamanda bazı alanlarda, özellikle güvenlik kıyaslamalarında DeepSeek v3'ten daha iyi performans gösterir.

Güvenlik karşılaştırmaları da dahil olmak üzere 10 AI karşılaştırmasından oluşan bir pakette Ai2, Tülu 3 405B RLVR modelinin ortalama 80.7 puana sahip olduğunu ve DeepSeek V3'ün 75.9'unu geride bıraktığını bildirdi. Ancak Tulu, 81.6 puan alan GPT-4o'da o kadar iyi değil. Genel olarak metrikler, Tülu 3 405B'nin kıyaslamalar arasında GPT-4o ve DeepSeek v3 ile en azından son derece rekabetçi olduğunu gösteriyor.

Açık kaynaklı yapay zeka neden önemlidir ve Ai2 bunu nasıl farklı yapıyor?

Tülu 3 405B'yi kullanıcılar için farklı kılan şey, Ai2'nin modeli nasıl kullanılabilir hale getirdiğidir.

AI pazarında açık kaynak konusunda çok fazla gürültü var. DeepSeek, modelinin açık kaynaklı olduğunu söylüyor ve Meta'nın Llama 3.1'i de Tülu 3 405B'den daha iyi performans gösteriyor.

Hem DeepSeek hem de Llama ile modeller ücretsiz olarak kullanılabilir; Ve hepsi olmasa da bazı kodlar mevcuttur.

Örneğin, DeepSeek-R1 model kodunu ve önceden eğitilmiş ağırlıklarını yayınladı, ancak eğitim verilerini yayınlamadı. Ai2, daha açık olmak için farklı bir yaklaşım benimsiyor.

Hajishirzi, "Herhangi bir kapalı veri kümesinden yararlanmıyoruz" dedi. "Kasım 2024'teki ilk Tülu 3 sürümümüzde olduğu gibi, tüm altyapı kodunu yayınlıyoruz."

Ai2'nin veri, eğitim kodu ve modelleri içeren tamamen açık yaklaşımının, kullanıcıların veri seçiminden değerlendirmeye kadar her şey için boru hatlarını kolayca özelleştirebilmelerini sağladığını da sözlerine ekledi. Kullanıcılar, Ai2'nin Tülu 3 sayfasından Tülu 3-405B de dahil olmak üzere Tülu 3 modellerinin tamamına erişebilir veya Ai2'nin Playground demo alanı aracılığıyla Tülu 3-405B işlevselliğini test edebilir.